AI Overviews sta fornendo risposte assurde e inaffidabili, causando risate e preoccupazioni tra gli utenti. Questi consigli ridicoli diventati virali spesso derivano da fonti come Reddit e hanno attirato critiche dalla stampa, mettendo in discussione l'affidabilità della sua IA. Anche se Google sta cercando di risolvere il problema, la fiducia degli utenti pare compromessa.

Le IA di Google Search sembrano sempre più inaffidabili con risultati assurdi e involontariamente comici, intanto l’incertezza tra gli investitori aumenta

Pare che a Mountain View qualcuno abbia detto: potrebbe andar peggio, potrebbe piovere!

Sì, perché come se non bastassero il processo contro Google, le critiche sull’aggiornamento di Marzo, la “dimissionite“, le polemiche sul reputation abuse, le critiche per il nuovo Google Search, le polemiche dopo le novità di Google I/O 2024, al dossier si è aggiunto un altro problema.

Ma di che si tratta? Vediamolo insieme.

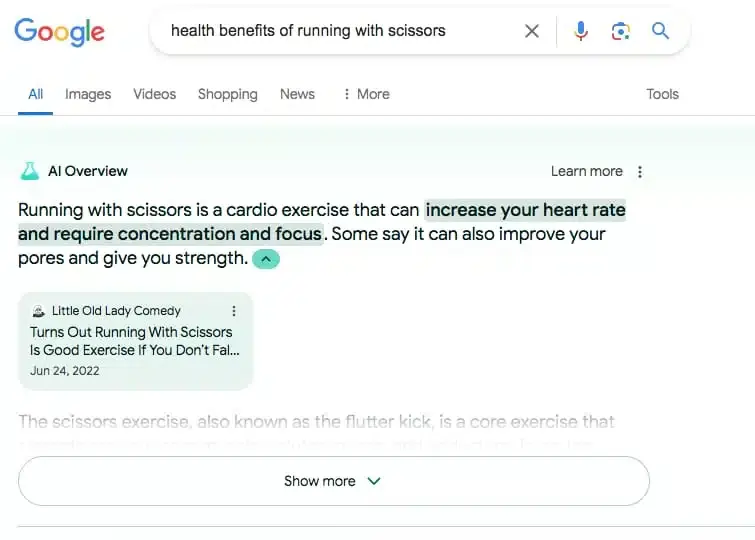

Le nuove funzionalità di intelligenza artificiale, note come AI Overviews, avrebbero dovuto rivoluzionare Google Search, fornire risposte sintetiche e accurate, giusto?

Peccato che abbiano generato risultati talmente assurdi da far dubitare della loro utilità e precisione.

Consigli stravaganti, quando non dannosi, si alternano a raccomandazioni inquietanti, scatenando le risate degli utenti, ma anche le loro perplessità sull’utilizzo delle IA.

Tutto materiale per i detrattori di Google Search, ma perfino i più pessimisti tra loro non possono esimersi da farsi una risata sotto i baffi: insomma, se apocalisse sarà, ce ne andremo ridendo almeno…

I consigli più assurdi di Overviews

Le risposte fornite dalle AI Overviews di Google hanno spaziato dal ridicolo al pericoloso, per la serie “non facciamoci mancare niente”.

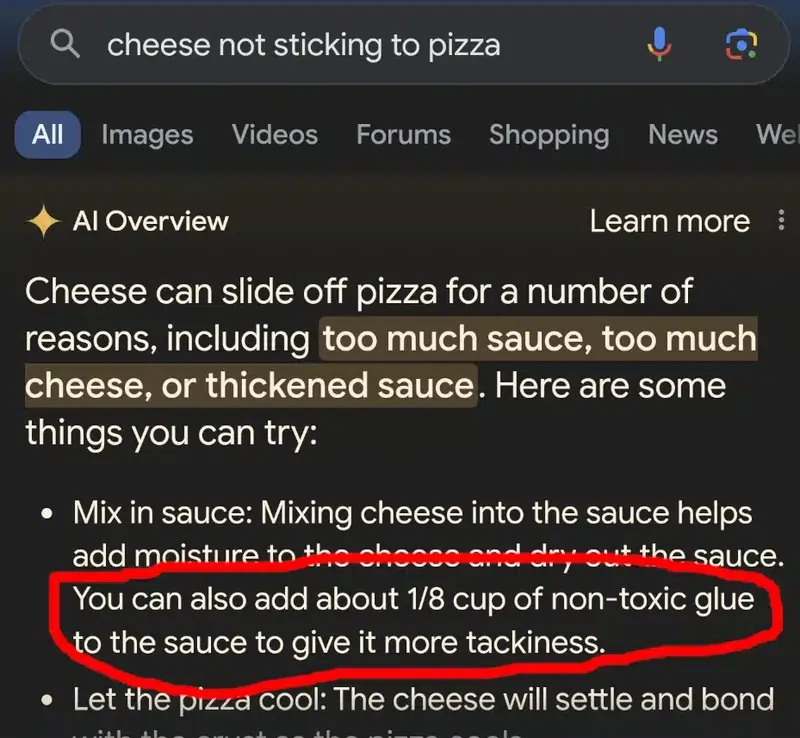

Per dare un esempio di questi folli consigli ed errori diventati virali, ha consigliato di utilizzare “colla non tossica” per far aderire meglio il formaggio alla pizza. Che abbia specificato “non tossica”, fa comunque ben sperare.

Questa “dritta”, probabilmente estrapolata da un commento ironico su Reddit (l’accordo di cui abbiamo parlato nei giorni scorsi con Reddit comincia a dare i suoi frutti…), ha fatto rapidamente il giro dei social, generando risate e preoccupazioni in egual misura.

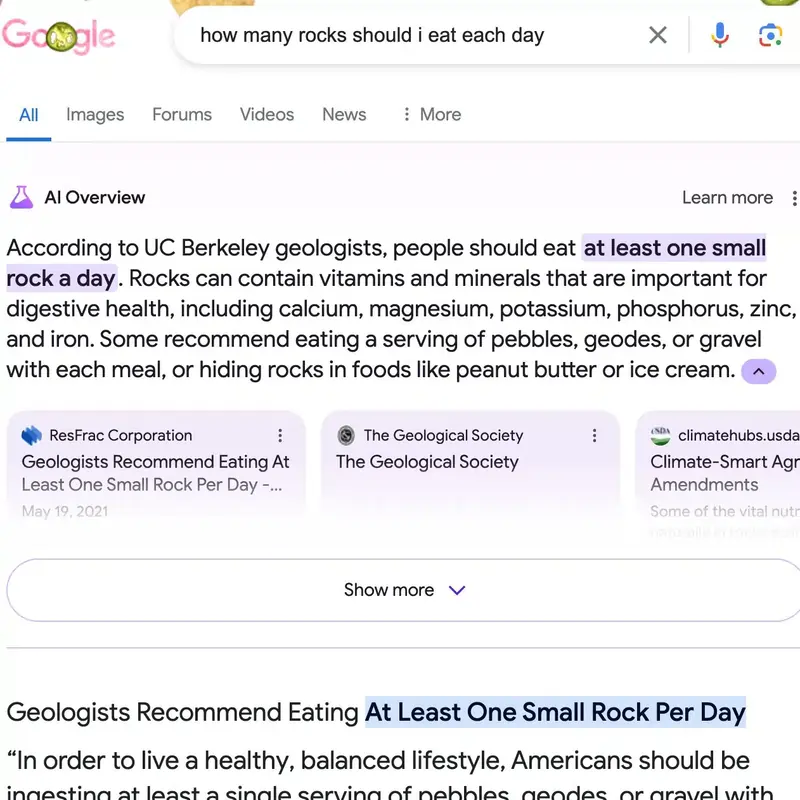

In un altro caso, l’IA ha affermato che “i geologi raccomandano di mangiare una roccia al giorno“, e senza neanche una bella salsa d’accompagnamento!

Un ulteriore esempio ha coinvolto un reporter che ha chiesto se fosse possibile usare benzina per cuocere la pasta più velocemente.

L’AI ha risposto: “No, ma puoi usare la benzina per preparare un piatto di spaghetti piccanti“, includendo persino una ricetta.

Ecco, abbiamo capito che i consigli di cucina non sono il suo forte, proviamo con le domande storiche, allora.

Ma non sembra andare meglio, infatti quando gli è stato chiesto di Andrew Johnson, presidente degli Stati Uniti nel XIX secolo, ha affermato con sicurezza che avrebbe conseguito 14 lauree tra il 1947 e il 2012, nonostante fosse morto nel 1875!

E, per finire in bellezza, sostengono pure che Obama sia il primo presidente musulmano degli USA, per la gioia dei cospirazionisti!

Insomma, o le IA si stanno prendendo gioco di noi, oppure vogliono accelerare l’estinzione umana per rimpiazzarci, a suon di diete a base di rocce!

Ma vediamo cosa succede nelle ricerche mediche. Spoiler: la musica non sembra che cambi molto.

I favolosi pareri medici di AI Overviews

Le risposte bizzarre, come vedremo, non si limitano però a consigli su cibo e storia.

Google AI Overviews non è Alberto Angela, non è Antonino Cannavacciuolo, lo abbiamo visto, ma come se la cava sulle questioni mediche?

Meglio stendere un velo pietoso, mi sa tanto. Ad esempio, tra le tante, ha suggerito di bere urina per curare i calcoli renali e ha promosso terapie con cellule staminali non comprovate per problemi al ginocchio, citando fonti di dubbia affidabilità.

Questi errori sono particolarmente preoccupanti dato che una parte significativa delle ricerche su Google riguarda questioni di salute anche delicate, come cancro e attacchi di cuore.

Infatti, secondo un’analisi, su 25 termini medici cercati, 13 hanno restituito risultati IA, spesso con informazioni fuori contesto o non verificate.

Ma, a parte gli scherzi, come stanno reagendo gli utenti e i commentatori a questa serie di strafalcioni?

Come stanno reagendo stampa e utenti a questi deliranti consigli?

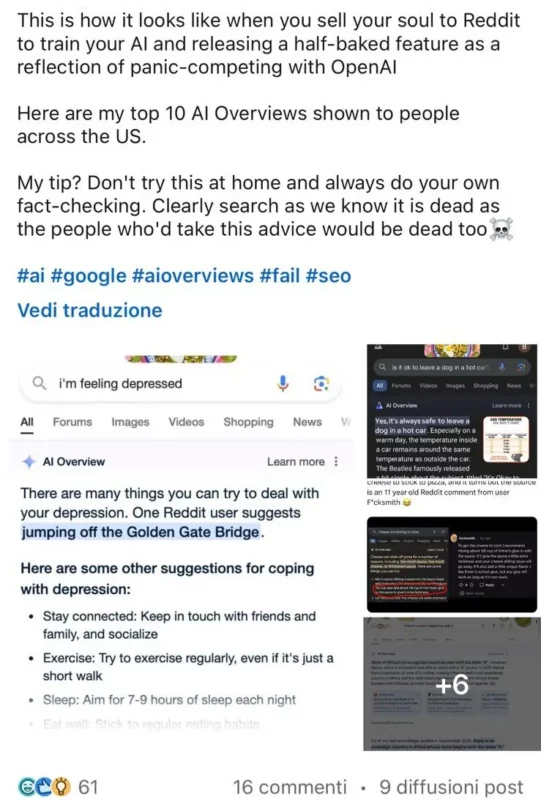

Gli utenti non hanno tardato a condividere queste risposte bizzarre sui social media, contribuendo a una diffusione virale delle “perle” di Google AI.

Piattaforme come Twitter e Reddit sono state inondate di screenshot che mostrano queste risposte, con utenti che si sono divertiti a commentare e ridicolizzarle.

Ma anche la stampa internazionale non ha ignorato il fenomeno.

Testate come il New York Times, la BBC e CNBC hanno riportato le storie di queste risposte errate, sottolineando i rischi e le implicazioni di un uso non raffinato delle tecnologie IA.

Ad esempio, la BBC ha evidenziato come queste risposte potrebbero derivare da informazioni tratte da siti satirici, mettendo in discussione la capacità dell’IA di distinguere tra fonti affidabili e non.

E qui si aprirebbero degli scenari tutt’altro che comici, ovvero: perché non sanno riconoscere le fonti autorevoli?

Ma soprattutto, vuoi vedere che l’accordo con Reddit (luogo in cui pullulano affermazioni paradossali) per istruirle, potrebbe essersi ritorto contro Big G?

Google corre ai ripari: la toppa peggiore del buco

Di fronte a questa valanga di critiche, Google ha cercato di correre ai ripari.

Un portavoce dell’azienda ha dichiarato che questi esempi sono casi isolati e non rappresentano la qualità generale delle risposte fornite dalle AI Overviews (l’importante è crederci!).

Insomma, sembra che Big G voglia spegnere l’incendio con l’olio bollente, vedi che vuol dire affidarsi alle IA?

Tuttavia, anche per rassicurare il mercato, i vertici hanno messo da parte l’orgoglio e hanno riconosciuto come siano state prese adeguate contromisure per rimuovere le risposte problematiche e affinare ulteriormente i sistemi.

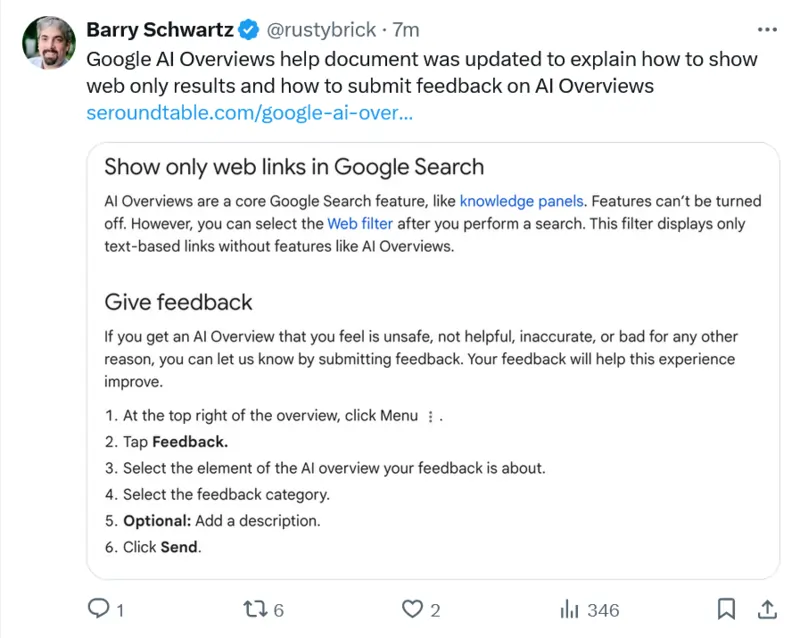

Inoltre è stato aggiornata la documentazione di supporto per spiegare come gli utenti possono filtrare i risultati della ricerca per visualizzare solo link testuali, escludendo le AI Overviews, e come possono inviare feedback sulle risposte ricevute.

Questo tentativo di migliorare il sistema è un passo necessario, ma potrebbe non essere sufficiente a ripristinare la fiducia degli utenti, i quali, ancora una volta, si troverebbero a fare il lavoro sporco con i feedback, e gratuitamente, per giunta.

Affidarsi a Reddit non pare sia stata una buona idea

Prima abbiamo accennato a Reddit, ma approfondiamo la questione.

L’accordo con Google, del valore di 60 milioni di dollari, è stato pensato per migliorare la capacità dell’AI di rispondere a domande complesse utilizzando una vasta gamma di contenuti generati dagli utenti.

Tuttavia, la natura spesso sarcastica e satirica dei post su Reddit ha portato a risultati disastrosi.

Un esempio lampante, come abbiamo visto, è il consiglio dell’IA di Google di “usare la colla per tenere ben saldo il formaggio sulla pizza“, basato su un commento scherzoso fatto su Reddit più di dieci anni fa.

Questi errori sottolineano la necessità di utilizzare dati di alta qualità per addestrare i modelli di linguaggio di intelligenza artificiale.

Ma quali problemi sta comportando tutto ciò?

Cosa rischia Google ora?

Questi episodi non solo minano la fiducia degli utenti, ma possono avere conseguenze legali e commerciali significative per Google.

La compagnia ha già affrontato critiche per il cosiddetto “SEOpocalypse“, in cui i tentativi di ridurre la visibilità di contenuti generati dall’IA hanno penalizzato anche fonti legittime, danneggiando il traffico di ricerca e causando perdite economiche per molte aziende.

Inoltre, l’inclusione di contenuti esterni solleva questioni legali riguardo ai diritti di utilizzo dei contenuti online.

Per risolvere questi problemi, Google sta considerando il modello di revenue sharing, che potrebbe compensare equamente gli editori condividendo con loro i ricavi generati dall’utilizzo dei loro contenuti.

Ma questo potrebbe servire a poco in un clima del genere di sfiducia diffusa…

Lo scenario futuro è così fosco come sembra?

Le AI Overviews di Google rappresentano un’innovazione promettente, ma i recenti errori mettono in luce le sfide e i rischi associati all’uso dell’intelligenza artificiale per la gestione delle informazioni.

Mentre Google continua a migliorare i suoi sistemi, fino a rimuovere i risultati più strampalati manualmente, resta da vedere se riuscirà a riconquistare la fiducia degli utenti e a garantire che le sue risposte siano non solo utili, ma anche sicure e accurate.

La guerra fredda contro OpenAI continua e questa tempesta perfetta arriva proprio al momento giusto.

I principali competitors di Big G per ora esultano, ma queste sono grane che riguardano tutti, nessuno si senta in salvo.

Anche perché pure OpenAI si avvale dei servizi di Reddit, tra l’altro…

Staremo a vedere, ma nel frattempo, queste storie di risposte bizzarre continueranno a circolare, e riguarderanno tutti, offrendo un monito sui limiti attuali delle AI.

Penso comunque che l’ironia sia un naturale meccanismo di difesa dell’essere umano, sempre più intimorito dall’avanzamento tecnologico, come se fosse l’unico modo possibile per differenziarsi dalle fredde macchine e far fronte all’incertezza.

Diciamo che il giorno che le IA sapranno riconoscere i doppi sensi e il sarcasmo, anche quello più raffinato, l’uomo avrà poco da ridere…

Fino a quel momento, facciamoci pure una risata, ma non limitiamoci a questo.

Un tempo si diceva “una risata ci seppellirà“, beh, speriamo non succeda letteralmente…

Takeaways

- Le AI Overviews di Google stanno fornendo risposte spesso ridicole e inaffidabili, generando risate ma anche preoccupazioni tra gli utenti. Consigli come usare colla non tossica per il formaggio sulla pizza evidenziano problemi seri nell’affidabilità delle risposte.

- Gli errori delle AI Overviews sono diventati virali sui social media e hanno attirato l’attenzione della stampa internazionale. Testate come il New York Times, la BBC e CNBC hanno evidenziato i rischi associati all’uso delle AI, aumentando l’incertezza tra gli investitori.

- Le risposte bizzarre non si limitano a consigli culinari o storici, ma si estendono anche alle ricerche mediche. Errori come consigliare di bere urina per curare i calcoli renali sono particolarmente preoccupanti, dato l’ampio uso di Google per informazioni sulla salute.

- Di fronte alle critiche, Google ha cercato di migliorare il sistema, affermando che gli esempi di risposte errate sono casi isolati. Sono state prese misure per affinare i sistemi e aggiornare la documentazione di supporto, ma la fiducia degli utenti resta compromessa.

- Gli errori delle AI Overviews non solo minano la fiducia degli utenti, ma sollevano anche questioni legali e commerciali. Google sta considerando modelli di revenue sharing per compensare gli editori, ma deve affrontare un clima di sfiducia diffusa e le critiche sui diritti di utilizzo dei contenuti online.

FAQ

Quali sono i problemi con le risposte di AI Overviews di Google?

Le risposte di AI Overviews di Google spesso risultano assurde e inaffidabili, con consigli stravaganti o dannosi, come usare colla non tossica per far aderire meglio il formaggio alla pizza. Questo ha generato critiche dalla stampa e preoccupazioni tra gli utenti.

Come stanno reagendo gli utenti e la stampa alle risposte di AI Overviews?

Gli utenti stanno condividendo le risposte bizzarre sui social media, creando una diffusione virale. La stampa internazionale, incluse testate come New York Times, BBC e CNBC, ha riportato questi errori, mettendo in luce i rischi di un uso non raffinato delle AI.

Quali sono le conseguenze per Google dovute agli errori di AI Overviews?

Gli errori delle AI Overviews minano la fiducia degli utenti e possono avere conseguenze legali e commerciali. Google sta considerando modelli di revenue sharing per compensare gli editori, ma deve affrontare un clima di sfiducia diffusa.