Il 24 settembre 2024 Google ha presentato i nuovi modelli di intelligenza artificiale Gemini-1.5-Pro-002 e Gemini-1.5-Flash-002, offrendo miglioramenti significativi nelle prestazioni e una riduzione dei costi delle API.

Nel frattempo, OpenAI ha risposto con l'introduzione della modalità Advanced Voice di ChatGPT, rendendo la competizione nel campo dell'IA ancora più serrata.

Ma OpenAI non sta a guardare e risponde con l’Advanced Voice Mode di ChatGPT

Il 24 settembre 2024 Google ha annunciato l’aggiornamento dei modelli Gemini pronti per la produzione, riduzione dei prezzi di 1.5 Pro e due nuovi modelli di intelligenza artificiale, Gemini-1.5-Pro-002 e Gemini-1.5-Flash-002.

Ora scommetto che tu, che sia un semplice utente o un imprenditore, ti stai chiedendo cosa possano fare per te e il tuo business.

Forse stai cercando di capire se queste innovazioni porteranno benefici concreti al traffico del tuo sito o se saranno solo l’ennesimo aggiornamento tecnico da ignorare. Ma attenzione, appena tu decidi di trascurare questa notizia, c’è pronto un tuo concorrente a beneficiare di queste innovazioni, per cui io ti ho avvisato…

Sì, perché queste nuove versioni di Gemini potrebbero davvero cambiare (in meglio) il modo in cui lavori. Perciò se il tuo obiettivo è migliorare la visibilità online (specie in epoca di AI Overviews), attirare più clienti e aumentare le vendite, queste novità potrebbero fare al caso tuo.

Ma non pensare che OpenAI stia a guardare; anche la società di Sam Altman ha annunciato una nuova funzionalità per Chat GPT: l’Advanced Voice Mode. Nel corso dell’articolo te ne parlerò approfonditamente.

Come vedi la battaglia tra OpenAI e Big continua a colpi di innovazioni sulle IA e ti spiegherò come queste potranno influire sul tuo lavoro e sulla tua quotidianità.

Le novità di Gemini 1.5 (e un glossario come bonus)

Partiamo dalle basi: Google ha appena presentato le versioni aggiornate dei suoi modelli di IA Gemini, chiamate Gemini-1.5-Pro-002 e Gemini-1.5-Flash-002.

Magari il nome non suona molto intrigante (sembra un nome freddo e asettico tipo il C-3PO di Star Wars o l’HAL 9000 di 2001: Odissea nello spazio), ma credimi, si tratta di innovazioni davvero interessanti, a dispetto del nome.

Questi modelli rappresentano un passo avanti rispetto ai loro predecessori, lanciati a maggio, e le novità non sono poche. Ci sono miglioramenti che ti faranno dire “Ah, finalmente!”, ma anche un paio di cosette che ti faranno storcere il naso, se sei un po’ cinico come me. Ma ci arriveremo.

Per darti un’idea delle migliorie, Google ha snocciolato una serie di dati che fanno la loro bella figura (puoi leggerli nel loro blog). In primo luogo, le prestazioni sono aumentate del 7% nei test MMLU-Pro (non hai idea di cosa siano? Non temere, ti spiego dopo), del 20% nei benchmark MATH e tra il 2% e il 7% in applicazioni di visione artificiale e codifica.

Ora, per quanto ti possa sembrare un mare di numeri, fidati: queste percentuali sono tutto tranne che trascurabili, soprattutto se stai pensando di implementare una IA nel tuo business per migliorare il supporto clienti o ottimizzare i processi aziendali.

Fermati lì, ti sto vedendo confuso! Anche io non sopporto gli articoli pieni di tecnicismi, per questo motivo, prima di proseguire, ecco un piccolo glossario, come ti avevo promesso:

- Un benchmark è un test standardizzato utilizzato per misurare e confrontare le prestazioni di un sistema, un software o un modello, come un’intelligenza artificiale, rispetto a uno standard o ad altri sistemi simili;

- il MMLU (Massive Multitask Language Understanding) è un benchmark che valuta la capacità dei modelli di intelligenza artificiale di comprendere e rispondere a domande in diversi domini e discipline, testando competenze come il ragionamento e la comprensione linguistica;

- MMLU-Pro è una versione avanzata del benchmark MMLU (Massive Multitask Language Understanding) progettata per testare le capacità dei modelli di linguaggio in modo più complesso e rigoroso. Include domande focalizzate sul ragionamento, con una scelta di risposte più ampia (dieci opzioni invece di quattro) per ridurre la possibilità di risposte casuali. Inoltre, elimina domande banali, rendendo il test più discriminante, e migliora la stabilità dei risultati sotto variazioni nei prompt, favorendo i modelli che utilizzano strategie di ragionamento avanzate.

Ecco, terminate queste doverose precisazioni, ritorniamo alle novità che riguardano Gemini!

I numeri dei nuovi Gemini: tutto su prestazioni e token

Dove però Google ha deciso di sorprendere analisti e consumatori è nel prezzo.

Se stai valutando di integrare un modello di IA, sai che il costo delle API (Application Programming Interface), ovvero le interfacce che permettono a diversi software di comunicare tra loro e scambiare dati o funzionalità in modo semplice e strutturato) può essere un bel grattacapo.

Ebbene, Google ha annunciato una riduzione dei prezzi (dal primo ottobre 2024) davvero imprevisto:

un calo del 64% per i token di input, del 52% per i token di output e un altro 64% per i token incrementali memorizzati nella cache.

Ora, cosa sono questi benedetti “token”? In parole povere, sono piccoli blocchi di testo che l’IA utilizza per elaborare informazioni. Più token usi, più ti costa.

Ridurre questi costi significa che le IA diventano più accessibili, soprattutto per chi non può permettersi di pagare cifre astronomiche.

Google ha inoltre incrementato i limiti di velocità per i modelli a pagamento: Gemini 1.5 Flash supporta fino a 2.000 richieste al minuto (RPM) e Gemini 1.5 Pro arriva a 1.000 RPM, molto più dei limiti precedenti, che erano di 1.000 e 360 RPM rispettivamente.

In parole semplici: la tua IA può fare molte più cose, molto più velocemente, e con meno spese.

Come vedi la saga Open AI contro Gemini prosegue a ritmi serrati e la concorrenza stimola Big G a investire tempo e risorse nella sua IA, proprio per non sfigurare con la società di Sam Altman.

Sì, perché Big G non vuole perdere terreno, specie dopo la prima metà del 2024 che l’ha vista prevalere nettamente nella sfida VS OpenAI come ti avevo scritto in questo mio articolo.

Gemini rivede (leggermente) la questione del politicamente corretto

Ma c’è di più. Google ha migliorato la capacità dei modelli di seguire le istruzioni degli utenti, il che può sembrare un’ovvietà, ma non è cosa da poco, specie in epoca di politicamente corretto e polemiche pretestuose (come emerge bene da questo approfondimento della BBC).

Ad esempio, se usi un chatbot sul tuo sito web, non vuoi che si metta a rispondere a caso.

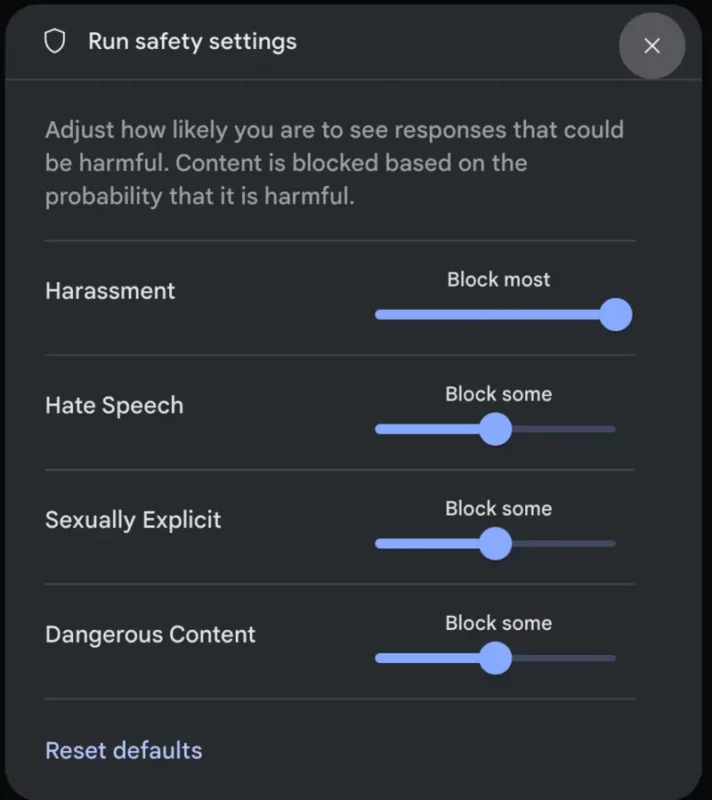

Ma, finora, i filtri di sicurezza di Gemini analizzavano le risposte dell’IA per individuare materiale inappropriato, come contenuti offensivi o pericolosi, e li bloccavano immediatamente.

Tuttavia, e qui arriva la parte interessante, i filtri di sicurezza per i contenuti IA non saranno più applicati di default!

Google ha deciso così di lasciare agli sviluppatori la libertà di implementare filtri come meglio credono. In pratica, meno babysitting da parte di Google, più autonomia per te.

Tutto ciò può essere visto anche come una risposta indiretta alle accuse di chi, come Ellon Musk, imputa a Big G un’eccessiva prudenza in termini di politicamente corretto, ma in realtà credo che semplicemente Google voglia soddisfare le richieste sempre più pressanti dei consumatori che non vogliono avere limitazioni in tal senso.

Gemini entra su My AI di Snapchat (e non c’è da stupirsi)

E poi arriva la ciliegina sulla torta: Snapchat ha annunciato che integrerà Gemini nelle funzionalità di My AI, il suo chatbot.

Ricordi quel chatbot di cui probabilmente non ti sei mai curato?

Beh, ora farà cose molto più utili grazie a Gemini. Ad esempio, sarà in grado di analizzare immagini, video e audio, il che significa che potrai chiedere al bot di tradurre un cartello stradale o dirti quale cibo è più salutare su un menu. Roba da Google Lens, ma dentro Snapchat!

Per chi come te si occupa di business, questa partnership potrebbe essere una finestra interessante per vedere come l’IA multimodale – cioè in grado di comprendere e interagire con diversi tipi di dati, come testo, immagini e video – può essere utilizzata per migliorare le esperienze degli utenti.

Snap ha dichiarato che l’uso del chatbot è aumentato di 2,5 volte negli Stati Uniti grazie a questa integrazione, come puoi leggere qui. Niente male, vero?

Snap e Google: una lunga storia d’amore

Snapchat non è nuovo a collaborazioni con Google.

Come sai, usano Google Cloud dal 2011 e hanno potenziato il loro My AI basato su OpenAI con Gemini per offrire esperienze più interattive e avanzate.

(Inoltre non dimenticare una notizia finita un po’ nel dimenticatoio: Google provò per ben due volte a comprare Snapchat!)

Cosa significa questo per te?

Beh, potrebbe significare che i chatbot di nuova generazione saranno in grado di comprendere e rispondere in modo più accurato e contestuale, migliorando l’esperienza utente.

Per cui le interazioni sul tuo sito o app potranno essere più coinvolgenti e personalizzate grazie alle IA.

Gemini si evolve: novità sorprendenti (e un’indiscrezione intrigante)

Un’altra notizia rilevante è l’introduzione ufficiale dell’app Gemini per gli utenti di Google Workspace. Durante il summit virtuale “Gemini at Work“, Google ha annunciato che l’app sarà disponibile per i piani Business, Enterprise e Frontline, con una particolarità significativa:

i dati delle aziende non saranno utilizzati per addestrare il modello di IA.

Gli amministratori potranno decidere come gestire la conservazione dei prompt e delle risposte, garantendo una maggiore sicurezza e controllo sui dati.

Questa mossa rappresenta un passo avanti per le aziende che vogliono integrare strumenti di IA senza preoccuparsi della gestione e della protezione delle informazioni aziendali.

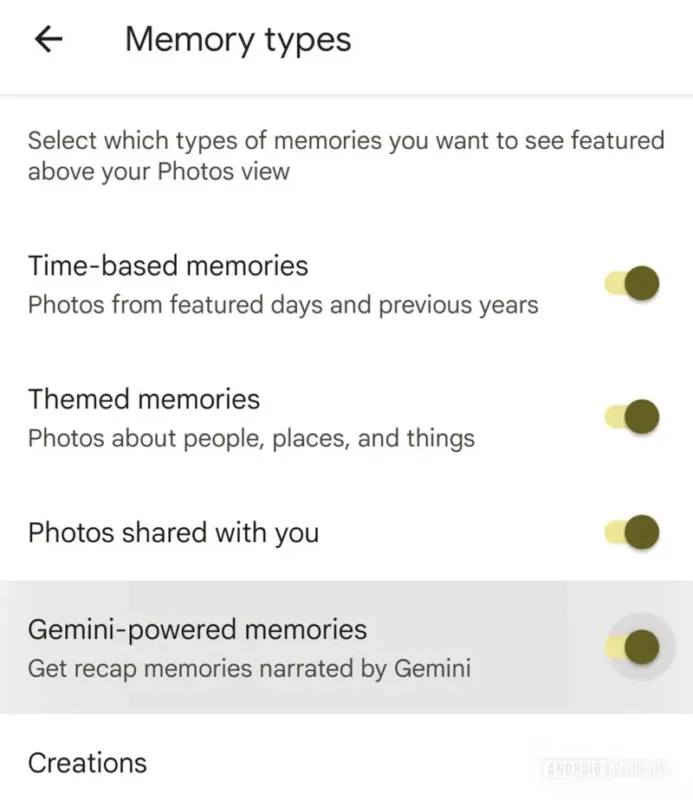

Prima di passare al prossimo paragrafo, infine, volevo proporti un’indiscrezione davvero sorprendente che riguarda Google Foto, pubblicata da Android Authority.

Senti qui: un team di esperti ha individuato frammenti di codice nell’ultima versione di Google Foto che suggeriscono l’implementazione di una nuova funzione basata sull’intelligenza artificiale.

Secondo i test, Gemini sarebbe in grado di creare presentazioni personalizzate dei Ricordi, con musica di sottofondo adatta al contenuto delle immagini e un commento testuale.

Tale funzione sfrutterebbe il riconoscimento delle immagini e altri dettagli come i tag di posizione per comprendere meglio i contesti delle foto, permettendo un’esperienza più immersiva e personalizzata.

Nonostante sia ancora un’indiscrezione, la possibilità che Google integri presto questa funzione non è così remota.

Ma ora passiamo al concorrente di Gemini: ChatGPT! Come risponde OpenAI a queste innovazioni di Big G?

OpenAI risponde a Google: ecco l’Advanced Voice Mode di ChatGPT

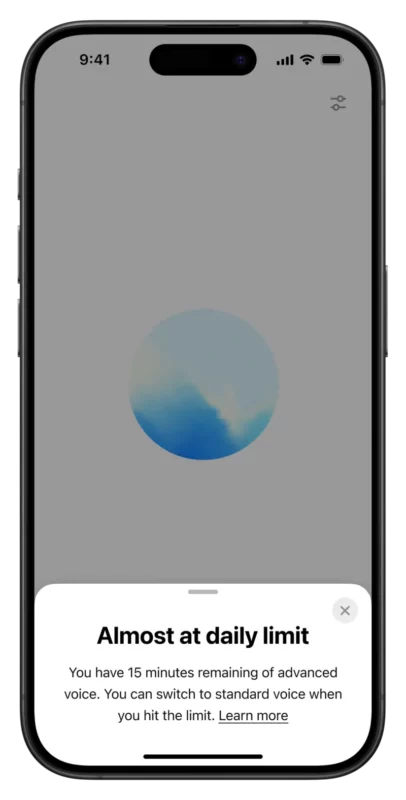

Le novità introdotte da Google con i nuovi modelli Gemini 1.5 non hanno lasciato OpenAI indifferente, che ha risposto prontamente, annunciando una nuova modalità di ChatGPT: Advanced Voice (AVM).

Lanciata per gli utenti paganti di ChatGPT, questa nuova modalità vocale di OpenAI consente un’interazione vocale più fluida e naturale, rivolgendosi agli utenti dei piani Plus e Teams. OpenAI ha promesso che anche gli utenti dei piani Enterprise ed Edu riceveranno l’accesso a questa nuova modalità entro la settimana successiva.

Advanced Voice Mode non è solo una funzione di riconoscimento vocale potenziata: OpenAI ha rinnovato l’interfaccia, sostituendo le classiche animazioni dei puntini neri con una sfera blu animata, dando al tutto un tocco più futuristico.

Gli utenti vedranno apparire un pop-up accanto all’icona vocale nell’app quando AVM sarà disponibile, e saranno in grado di testare cinque nuove voci — Arbor, Maple, Sol, Spruce, e Vale — che si aggiungono alle già esistenti Breeze, Juniper, Cove e Ember, per un totale di nove.

Questo rende ChatGPT quasi all’altezza del modello Gemini Live di Google, che vanta numerose voci personalizzabili (siamo ancora in attesa di Ruby e River, ma la vedo difficile, ormai…).

Un altro dettaglio interessante è l’attenzione di OpenAI alla personalizzazione.

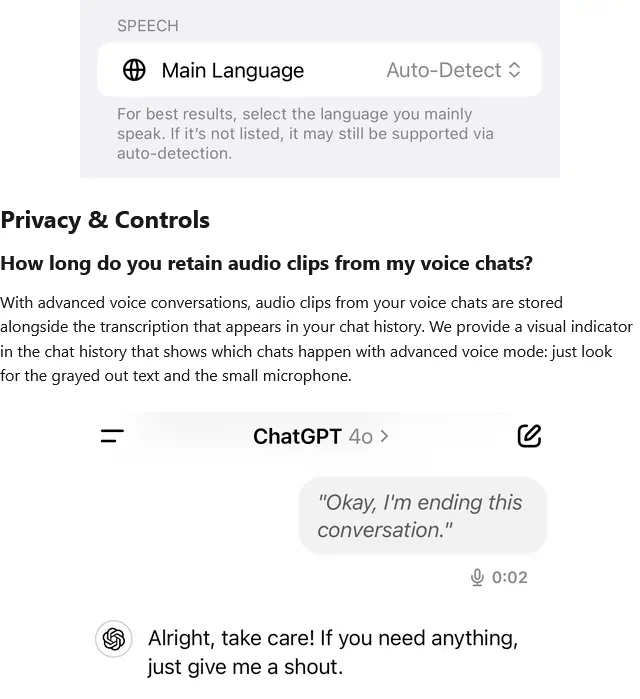

AVM ora supporta le Custom Instructions, che permettono agli utenti di configurare ChatGPT in modo che risponda in base alle preferenze personali, e Memory, che consente al modello di ricordare conversazioni precedenti per fare riferimento ad esse in seguito.

OpenAI ha anche migliorato la comprensione degli accenti, rendendo le conversazioni con ChatGPT più veloci e fluide, e introducendo la capacità di rispondere in più di 50 lingue con frasi come “Sorry I’m late”.

Un’altra funzione attesa, la modalità video e condivisione dello schermo, mostrata da OpenAI durante l’aggiornamento di primavera, non è ancora stata rilasciata.

E ricorda che OpenAI non si limita a voler sfidare Google sul piano delle IA, ma anche dei motori di ricerca come testimonia il lancio di Search GPT.

Con queste novità, come puoi ben capire, la battaglia tra i due colossi dell’intelligenza artificiale si fa sempre più interessante, lasciando intendere che vedremo ulteriori sviluppi nei prossimi mesi, specie dopo l’alleanza tra Apple e Open AI contro Google!

Google e OpenAI: la battaglia per la supremazia dell’IA è solo all’inizio

Le novità introdotte da Google con i modelli Gemini-1.5 non sono solo una risposta a una crescente concorrenza: sono un segnale forte di come il gigante di Mountain View sia obbligato a difendere la sua reputazione in un mercato sempre più competitivo.

Con OpenAI che continua a lanciare innovazioni come l’Advanced Voice Mode di ChatGPT, Google non può permettersi di restare indietro, nonostante i costi elevatissimi per potenziare Gemini.

Come ti ho detto in altri articoli, Big G possiede le infrastrutture per rendere Gemini leader del mercato, ma i costi per farlo rischiano di essere ben superiori ai ricavi previsti.

Ma Google, stimolata dalla crescente concorrenza, specialmente dopo l’alleanza tra Apple, Nvidia e OpenAI, è costretta a spingere ancora di più sulla sua intelligenza artificiale, anche oltre quanto inizialmente preventivato. E, anche in questo senso, va letto il ritorno in Google di Sergey Brin, co-fondatore dell’azienda.

Inoltre non dimenticare l’elefante nella stanza: dopo la condanna per monopolio di Google negli USA, ora la società rischia perfino uno smembramento (il DoJ minaccia di sottrarle Chrome o Android, per esempio).

Insomma, Big G si ritrova a dover bilanciare il progresso tecnologico con una serie di problemi legali che minacciano la sua stabilità.

Per cui, la battaglia tra OpenAI e Google è quindi molto più di una semplice corsa all’innovazione: è una lotta per il controllo del futuro dell’intelligenza artificiale.

Takeaways

- Google ha presentato due nuovi modelli di IA, Gemini-1.5-Pro-002 e Gemini-1.5-Flash-002, con miglioramenti significativi in prestazioni (+7% nei test MMLU-Pro e +20% nei benchmark MATH) e una drastica riduzione dei costi delle API.

- Google ha abbassato i prezzi dei token fino al 64%, rendendo le sue API IA più accessibili e competitive, il che potrebbe attrarre sviluppatori e aziende, stimolando l’adozione su larga scala.

- OpenAI ha lanciato l’Advanced Voice Mode per ChatGPT, introducendo nuove voci e funzionalità personalizzate, con l’obiettivo di rendere l’interazione vocale più naturale e competitiva rispetto ai progressi di Google.

- Google, con Gemini su Workspace, garantisce che i dati aziendali non saranno utilizzati per addestrare l’IA, una mossa cruciale per rassicurare le imprese sulla gestione sicura dei loro dati.

- La competizione tra Google e OpenAI non riguarda solo l’innovazione, ma anche la reputazione, con Google costretta a investire pesantemente per mantenere la leadership nel mercato IA, in un contesto di pressioni legali e rischio di smembramento aziendale.

FAQ

Quali sono i nuovi modelli di intelligenza artificiale presentati da Google?

Google ha presentato due nuovi modelli di IA, Gemini-1.5-Pro-002 e Gemini-1.5-Flash-002, che offrono significativi miglioramenti nelle prestazioni e una riduzione dei costi delle API.

Cosa ha annunciato OpenAI in risposta alle novità di Google?

OpenAI ha risposto con il lancio della modalità Advanced Voice (AVM) per ChatGPT, introducendo nuove voci e migliorando l’interazione vocale per gli utenti paganti.

In che modo Google ha ridotto i costi delle API di Gemini?

Google ha annunciato una riduzione del 64% per i token di input, del 52% per i token di output e un ulteriore 64% per i token incrementali memorizzati nella cache, rendendo le API più accessibili.